桔了个仔的回答

别狐假虎威。

ChatGPT强大,Claude强大,那时ChatGPT本身强大,Claude本身强大,而不是因为闭源了所以变得强大。

推理成本低,也和闭源或者开源没啥直接联系。

从机器学习到深度学习,再到现在GenAI时代,模型之间谁更好,其实都有量化的指标。

在机器学习时代,有accuracy/precision/AUC;深度学习时代,有各种测试集,例如ImageNet,

GenAI时代,也会有很多公开的榜单,例如open_llm_leaderboard,SuperCLUE等。

但在榜单上,文心一言出现的频率也不高啊。

同时李彦宏还提到,闭源模型一定比开源模型推理成本更低,更是无稽之谈。

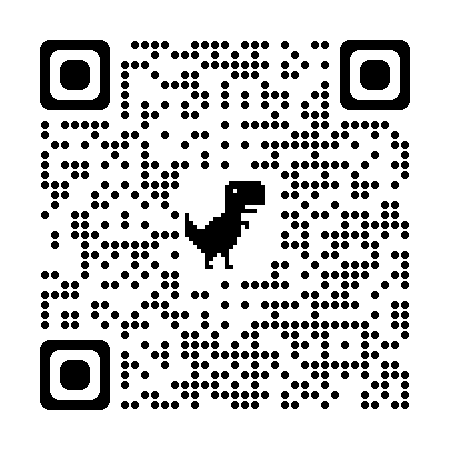

看看The LLM Inference Provider Leaderboard,看看前面的是开源还是闭源模型?

更别说推理成本除了模型本身的大小和架构(例如MoE架构相对推理成本低),也受云服务器本身价格影响。云厂商一降价,推理成本也会跟着降。

更别说还有的厂商,模型做得好,云服务做的更好,既有开源大模型,也有闭源大模型。你百度能不能从模型性能上拼赢别人都需要打个问号(毕竟人家有榜单成绩),更别说人家用自家服务器跑自家模型更有成本上优势了。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...